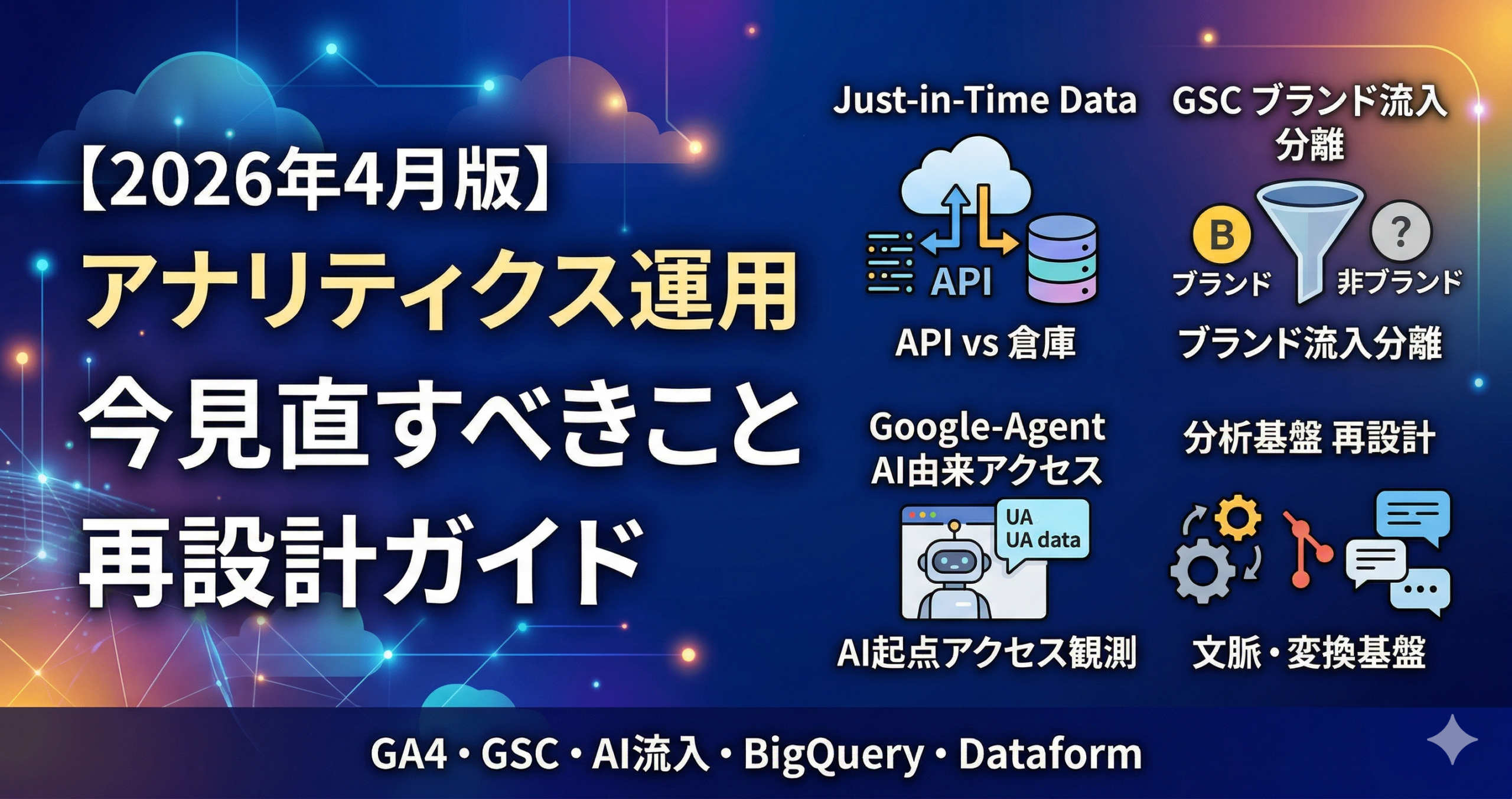

【2026年4月版】アナリティクス運用で今見直すべきことは?GA4・GSC・AI流入・分析基盤の再設計ガイド

2026年のアナリティクス実務は、単にレポートを増やす段階から、どのデータを保存し、どのデータをAPIで取り、どの指標をAIや人間がどう読むかを再設計する段階に入っています。参照元の Two Octobers の April 2026 roundup は、Just-in-Time 的なデータ取得の発想、Search Console の branded query filter、Google-Agent、Meta の attribution 設計変更、BigQuery の conversational analytics、Dataform、triangulated attribution などを横断的に取り上げています。この記事では、それらを日本のデジタルマーケ実務へ落とし込み、「今日から何を点検すべきか」という運用ガイドとして再構成します。

すべてを倉庫に貯めるより、APIで足りるか、保存が必要かを用途別に分ける発想が重要になっています。

Search Console の branded queries filter により、ブランド流入と非ブランド流入を公式UIで分けて見やすくなりました。

Google-Agent の登場で、AIユーザー起点のアクセスをログや分析で見分ける視点がより重要になっています。

BigQuery の conversational analytics や Dataform は、AI分析を支える前提として、文脈付きデータと整った変換基盤を求めます。

- イントロダクション

- 概要

- 利点

- 応用方法

- 導入方法

- 未来展望

- まとめ

- FAQ

- GA4 のデータは全部 BigQuery に保存したほうが良いですか?

- Search Console の branded queries filter は regex の代わりになりますか?

- Google-Agent がログに出たら、AI Mode で評価されていると考えてよいですか?

- BigQuery の conversational analytics は、SQLを書けない人向け機能ですか?

- Dataform はデータエンジニア向けで、マーケ担当には難しすぎませんか?

- Meta などの指標定義変更は、どう報告すればよいですか?

- GA4 と GSC の統合は Looker Studio のブレンドでも十分ですか?

- AI-assisted analysis を導入するとき、最初に何を決めるべきですか?

- 参考サイト

イントロダクション

なぜ今、アナリティクスの論点を「GA4の見方」だけでなく、データ取得、AI流入、分析補助、アトリビューションまでまとめて見直す必要があるのかを整理します。

結論先出し:今のアナリティクス実務で重要なのは、データ量を増やすことではなく、目的に応じて取得・保存・分析・説明の流れを分けることです。レポートの数より、どの数字を誰にどう説明するかの設計が差になりやすくなっています。

日本の現場では、GA4、GSC、Google Ads、Meta、CRM、BI、BigQuery、Looker Studio がそれぞれ別の文脈で使われやすく、会議のたびに「この数字は何を意味するのか」という確認から始まりがちです。そこへ AI検索、AIによるサイト利用、会話型分析、計測定義の変更が重なると、従来の月次レポートだけでは判断が追いつきにくくなります。Two Octobers の roundup も、単なる機能紹介ではなく、「今までのやり方をそのまま延長すると無駄やズレが増える」という問題意識で論点を並べています。

この記事では、特に次の四つを軸に整理します。ひとつ目は、API と warehouse の役割分担です。ふたつ目は、ブランド流入と AI起点アクセスの見方です。三つ目は、AI-assisted analysis を安全に回すための基盤です。四つ目は、指標変更や attribution のズレを社内でどう説明するかです。これらは別々の話に見えますが、実務では同じ運用設計の上に乗っています。

- データは何でも保存すべきか、それともAPIで十分な場面があるのか

- ブランド流入と非ブランド流入を今どう見分けるべきか

- Google-Agent などAI由来のアクセスはどこまで観測できるのか

- BigQuery の conversational analytics や Dataform は何のために導入するのか

- ソーシャルや attribution の定義変更を、どう社内説明へ落とすべきか

- 新機能を追うことより、既存の運用フローをどこで見直すかが重要です。

- AIに分析を任せる前に、データ定義と文脈を整理する必要があります。

- ブランド分析と非ブランド分析を混ぜたままだと、SEO改善の優先順位が見えにくくなります。

- AI流入の観測は、順位改善の話ではなく、利用実態の把握とログ設計の話です。

概要

用語と全体像をそろえながら、従来の考え方との違いを分かりやすく整理します。

結論先出し:これからのアナリティクス運用は、「全部集めて後で考える」より、「何の意思決定に使うかに応じて、取得・保存・変換・分析を分ける」設計へ寄りやすくなっています。

Just-in-Time Data Management とは何か

参照元の筆者は、必要なデータを warehouse にすべてため込むのではなく、用途によっては API からその場で取得するほうが自然だったと述べています。これは warehouse 不要論ではなく、「保存は価値そのものではなくコストでもある」という見方です。一方で、Google Analytics Data API は GA4 レポートデータへ programmatic にアクセスでき、BigQuery には BigQuery export や変換基盤の利点があります。つまり実務では、API と warehouse を対立でなく役割分担で考えるべきです。

ブランド流入の分析は、正規表現だけの時代ではなくなってきた

Search Console の branded queries filter は、brand name、表記ゆれ、誤字、関連する unique product or service まで含めて branded / non-branded を分ける機能として提供されています。Google は、この分類が正規表現ではなく内部の AI-assisted system に基づくと説明しており、誤分類の可能性も認めています。つまり、今後は regex のみでブランド分析を回すより、公式分類を起点にしながら、人間側で補正するほうが実務に合いやすいです。

Google-Agent は何を意味するのか

Google の crawling infrastructure documentation では、Google-Agent は Google infrastructure 上の agents が、ユーザーのリクエストに応じて web を navigate し actions を perform するための user agent と説明されています。同じページでは、user-triggered fetchers は一般に robots.txt を無視すること、UA は spoof できるため reverse DNS などで検証すべきことも案内されています。実務では、これは「AI Mode の順位が分かる」話ではなく、AIユーザー起点の fetch をログで切り分ける起点が増えたと理解するのが妥当です。

会話型分析は、AIに丸投げする機能ではない

BigQuery の conversational analytics は、自然言語で data agents に質問できる仕組みですが、Google はその前提として、knowledge sources の選択、custom metadata、instructions、verified queries を用意できることを示しています。つまり、ただチャットするだけではなく、AIがどの文脈で質問を解釈すべきかを設計する仕組みです。Two Octobers の roundup で紹介されていた “AI-assisted vs. AI-led” という視点とも整合しており、LLM の出力をそのまま意思決定に使う前に、文脈と検証を設計する必要があります。

APIで足りるのか、保存が必要なのかを用途別に決めます。

ブランド、非ブランド、AI起点アクセスなどを分けて見ます。

BigQuery と Dataform で変換、テスト、依存関係を管理します。

人間が仮説を立て、AIは補助として使います。

指標変更や attribution のズレを比較可能な形で共有します。

| 見方 | 従来の運用 | これからの運用 |

|---|---|---|

| データ取得 | まず保存してから考える | API取得か保存かを用途で分ける |

| SEO分析 | regex中心でブランド分類 | 公式 branded filter を軸に補正する |

| AI流入 | 参照元不明でまとめて見る | Google-Agent などをログで切り分ける |

| 分析AI | 質問だけ投げる | 文脈、指示、verified queries を設計する |

利点

どんな課題が改善されやすいのかを、効果ではなく運用・判断・連携の観点から整理します。

結論先出し:今回の論点を整理すると、レポート作業そのものより、「数字の意味がぶれにくくなる」「比較しやすくなる」「AIを安全に補助として使いやすくなる」という利点が出やすいです。

ブランド分析がぶれにくい

branded / non-branded を公式機能で分けられるため、SEO会議での前提合わせがしやすくなります。誤分類の可能性はあるものの、複雑な regex の維持負荷は下げやすいです。

AI起点の利用実態を追いやすい

Google-Agent などの user-triggered fetchers を視野に入れることで、従来の検索流入だけでは見えにくかった AI由来のアクセスをログ観点で扱いやすくなります。

分析基盤の再現性が上がりやすい

Dataform は BigQuery 上で変換、依存関係、テスト、ドキュメント、Git連携を扱えるため、属人的な SQL 運用を減らしやすいです。

どんな会社・どんな体制で恩恵が出やすいか

- SEO、広告、CRM、営業が別々にレポートを持っている会社

- GA4 と GSC を見ているが、ブランド流入の整理が毎回ぶれる会社

- BigQuery を使っているが、テーブル定義や変換ロジックが属人化している会社

- AI分析を試したいが、誤読や hallucination が怖くて本番投入しにくい会社

- ソーシャル広告の比較で、定義変更の影響を社内に説明しづらい会社

利点を過大評価しないための注意点

- branded filter は便利ですが、誤分類があり得るので機械判定をそのまま絶対視しないほうが安全です。

- Google-Agent を見つけても、それだけで AI検索での評価を判断できるわけではありません。これは fetch の観測点です。

- Data agent を作っても、定義や verified queries が弱いと回答品質は安定しにくいです。

- Meta などの attribution 定義変更は比較値を崩すため、旧指標と新指標の橋渡し期間が必要です。

応用方法

どの場面で、何を見て、どう判断するかを、検索意図の違う実務ユースケースごとに整理します。

結論先出し:応用のコツは、すべてを一つのダッシュボードに詰め込むことではありません。分析テーマごとに、使うデータ取得方法、見る粒度、説明相手を切り替えることが重要です。

SEO運用では branded / non-branded を分けて議論する

Search Console の branded queries filter は、web・image・video・news など search types across で使え、impressions、clicks、CTR、average position を branded または non-branded に絞って見られます。SEO実務では、ブランド需要の増減と非ブランド流入の伸びを分けることで、施策評価がかなり整理しやすくなります。特に、広報や指名検索の増加を SEO改善と混同しないために有効です。

サーバーログ分析では Google-Agent を切り分ける

開発やテクニカルSEOの担当者は、従来の Googlebot だけでなく、Google-Agent、Google-NotebookLM、FeedFetcher など user-triggered fetchers の種類を押さえておくと、ログ解釈がしやすくなります。Google は user agent string の例と associated products を公開しており、UA spoofing への注意も促しています。AI時代のアクセス観測は、検索流入レポートより先にログ基盤で差がつきやすいです。

GA4 と GSC の統合分析では BigQuery を中継点にする

Google Search Central は、Search Console と Google Analytics のデータを SEO分析で組み合わせる際、もっとも効果的な方法は Search Console bulk exports と Google Analytics BigQuery exports を使って BigQuery 上で扱うことだと説明しています。つまり、GA4 と GSC の画面を並べて見るだけでなく、BigQuery で結合しやすい設計へ寄せると、クエリ、ランディングページ、デバイス、国などを横断して見やすくなります。

ソーシャル広告では定義変更の橋渡し期間を作る

参照元 roundup は、Meta が click-through conversions の数え方を見直し、engage-through conversions を分けたことで、click-through conversions や conversion rate が見かけ上変わり得ると指摘しています。この種の変更は、運用担当には自然でも、経営や営業には「悪化」に見えやすいです。実務では、一定期間だけ旧比較軸に近い合成指標を併記しながら、新定義へ移行する説明が必要です。

AI-assisted analysis では verified queries を先に作る

BigQuery conversational analytics の公式ドキュメントでは、agents に custom table metadata、instructions、verified queries を設定できると案内されています。これは、よくある経営質問や週次会議の定番分析を、AIへ丸投げするのでなく、検証済みの分析パターンとして登録しておく考え方です。現場では、「先月比の主要変化」「ブランド流入の変化要因」「特定LPの寄与」などを verified query として整備すると使いやすくなります。

アトリビューションでは “ひとつの正解” を諦める

参照元 roundup は、click-based MTA と MMM / incrementality の二項対立だけでなく、inference や qualitative data を組み合わせた triangulated attribution の考え方を紹介しています。日本の実務でも、検索広告、オーガニック、CRM、営業接点を一つの attribution model だけで決め切るのは難しい場面が多いです。だからこそ、運用では「観測できるもの」「推定するもの」「現場ヒアリングで補うもの」を分けて説明するほうが誤解が少なくなります。

導入方法

設計 → 準備 → 運用 → 改善 → ガバナンスの順で、現場で動かしやすい導入方法を示します。

結論先出し:導入で最初に決めるべきことは、どのツールを増やすかではなく、「どの会議で、どの問いに答えるための分析なのか」です。そこが曖昧なまま機能を追加すると、ダッシュボードもAI分析も増えるだけで使われにくくなります。

設計では、分析テーマごとに API と warehouse を分ける

まずは、何を API で即時取得し、何を BigQuery に蓄積するかを切り分けます。日次モニタリングや軽量な社内ツールなら Data API が向くことがありますが、GSC や GA の横断分析、履歴比較、複数ソース結合、変換テストが必要なら BigQuery 寄りです。参照元の Just-in-Time 的な発想は、「全部保存しない」ことではなく、「保存する理由を持つ」ことだと理解すると運用に落とし込みやすいです。

| 用途 | 向きやすい取得方法 | 判断基準 |

|---|---|---|

| 速報確認 | API中心 | 軽量・短期・単一ソースで足りるか |

| 横断分析 | BigQuery中心 | GA4、GSC、広告、CRMをつなぐ必要があるか |

| AI補助分析 | BigQuery + data agent | 文脈、metadata、verified queries を設計できるか |

| 週次定点観測 | BigQuery + BI | 定義固定、再現性、説明責任が必要か |

準備では、ブランド分類と AI流入観測の基準を作る

- branded filter と社内のブランド定義を突き合わせる

- Google-Agent などログで切り分けるUAを一覧化する

- SEO会議で branded / non-branded を別々に報告する

- AI起点アクセスを検索順位と混同しない

- regex分類だけでブランド分析を完結させていないか

- UA文字列だけを見て Google 確定としていないか

- ログを見る担当とレポートを見る担当が分かれたままになっていないか

- 誤分類があった時の補正ルールを決めているか

運用では、Dataform で変換ルールをコード管理する

Dataform は、BigQuery 上の ELT で、複雑な transformation workflows を develop, test, version control, schedule できるサービスとして案内されています。依存関係の可視化、テスト、ドキュメント化、Git連携まで含めて扱えるため、GA4 export や GSC export を整形して、レポート用テーブルや AI用テーブルを分ける設計に向いています。日本の現場では、担当者の手元SQLだけで進めず、Dataform のような形で変換ルールを共有可能にする価値が高いです。

改善では、verified queries をテンプレ化する

BigQuery conversational analytics は、agent に対して verified queries を持たせられます。これは「毎週同じ質問に対して、毎回ちがう解釈をするAI」を避けるために重要です。まずは、経営、マーケ責任者、運用担当が繰り返し使う分析を少数に絞って定義し、その答え方を整えると運用しやすくなります。

ブランド流入と非ブランド流入の変化 / 主要LPの流入要因 / 先月比の異常値 / Google-Agent のログ傾向 / 広告媒体別の定義差説明

ガバナンスでは、指標変更の比較ルールを残す

参照元 roundup が示すように、Meta の click-through conversion のような定義変更は、実績そのものより比較可能性を壊しやすいです。実務では、「いつから定義が変わったか」「旧定義に近い補助指標を何にするか」「どの会議までは併記するか」を運用ルールとして残す必要があります。アトリビューションや social の定義変更は、担当者の記憶に頼らず履歴化するほうが安全です。

- Data warehouse を作っただけで分析基盤が完成したと思ってしまう

- AI agent に質問だけ投げて、文脈設計をしない

- ブランド流入の増減を、そのままSEO改善として報告する

- Google-Agent の観測を、検索評価の証拠として扱ってしまう

- 媒体側の定義変更を、前年同月比較にそのまま使ってしまう

最初に小さく始める方法

- Search Console の branded filter を使って、ブランド / 非ブランドを分けた定点表を作る

- サーバーログで Google-Agent を含む user-triggered fetchers を切り分ける

- GA4 と GSC を BigQuery でつなぐ最小テーブルを一つ作る

- Dataform で主要変換だけを管理し始める

- 会議で使う verified query を三つだけ決める

未来展望

今後どのような運用や考え方が広がりそうかを、断定しすぎずに整理します。

結論先出し:今後のアナリティクスは、ひとつの画面ですべてを見る方向より、API・warehouse・AI・ログを役割分担しながらつなぐ方向へ進みやすいです。変化があっても通用しやすいのは、定義と文脈を整えた運用です。

分析基盤は “ためる” から “使い分ける” へ進みやすい

API、BigQuery、BI、AI agent の役割分担が進むほど、すべてを一箇所に保存すること自体は目的になりにくくなります。必要な履歴や結合は BigQuery に寄せつつ、短期の軽量分析は API で済ませるような設計が増えやすいです。参照元 roundup の Just-in-Time 的な問題提起は、今後のコスト管理や運用負荷にもつながる論点です。

AI起点の利用観測は、検索レポートだけでは足りなくなりやすい

Google-Agent のような公開ドキュメントが増えることで、AI由来のアクセスをログで捉える視点は広がりやすいです。ただし、UA だけでは判定し切れないため、ログ、DNS検証、行動データをあわせて解釈する姿勢が引き続き必要です。

会話型分析は、verified knowledge の運用が差になりやすい

BigQuery の data agents は、ただの質問UIではなく、metadata や verified queries を持つ分析レイヤーとして整備されつつあります。今後は「AIが分析してくれる」より、「AIが誤読しにくい定義を持っている」ことのほうが価値になりやすいです。

commerce 側では agentic 行動の計測が増える可能性がある

参照元 roundup が触れていた Universal Commerce Protocol は、Google が AI Mode や Gemini 上で direct buying を可能にする open standard として案内しています。今すぐ全社導入の話ではありませんが、今後は「検索してサイトへ来る」以外の conversion path も増える可能性があり、計測設計は問い合わせや購入の“画面遷移”だけでなく、プロトコルや外部面の行動も意識する必要が出てきそうです。

まとめ

最後に、要点と次に取りたい小さなアクションを整理します。

結論先出し:2026年4月時点のアナリティクス運用で重要なのは、新機能を全部追うことではなく、ブランド分析、AI流入観測、データ基盤、AI補助分析、指標比較ルールをつなげて見直すことです。

- API と warehouse は対立ではなく、用途で切り分けるべきです。

- Search Console の branded queries filter は、SEO評価の前提を整理しやすくします。

- Google-Agent は AIユーザー起点の fetch をログで捉える視点を与えます。

- BigQuery conversational analytics は、metadata と verified queries が前提です。

- Dataform のような変換基盤は、AI時代でも再現性のある分析を支えます。

- ブランド / 非ブランドを分けた定点観測を作る

- Google-Agent を含む AI系 UA のログ切り分けを始める

- GA4 と GSC の BigQuery 結合を最小構成で試す

- Dataform で主要変換ルールをコード化する

- AI agent 用の verified query を三つ定義する

FAQ

初心者がつまずきやすい疑問と、中級者が判断に迷いやすい論点をまとめます。

GA4 のデータは全部 BigQuery に保存したほうが良いですか?

必ずしもそうではありません。用途が軽く、短期の確認で足りるなら API が向く場面もあります。一方、履歴比較、他ソース結合、変換テスト、再利用性が必要なら BigQuery の価値が高くなります。重要なのは保存そのものではなく、保存理由を持つことです。

Search Console の branded queries filter は regex の代わりになりますか?

起点としては有用ですが、完全な代替と考えすぎないほうが安全です。Google は内部の AI-assisted system で分類しており、誤分類の可能性も明示しています。まず公式分類で全体傾向を見て、必要なところだけ人間が補正する使い方が現実的です。

Google-Agent がログに出たら、AI Mode で評価されていると考えてよいですか?

そこまで言い切るのは早いです。Google は Google-Agent を、ユーザーリクエストに応じて web を navigate し actions を perform する agent の UA と説明しています。実務では、AI起点の fetch を観測する材料として使い、検索評価の断定には使わないほうが安全です。

BigQuery の conversational analytics は、SQLを書けない人向け機能ですか?

それだけではありません。Google のドキュメントでは、agents に custom metadata、instructions、verified queries を持たせる前提が示されています。つまり、分析を簡単にするだけでなく、質問解釈を組織でそろえる仕組みでもあります。

Dataform はデータエンジニア向けで、マーケ担当には難しすぎませんか?

たしかに技術要素はありますが、Dataform は data analysts 向けに、BigQuery 上の変換、テスト、依存関係、ドキュメント、スケジュールを扱えるよう設計されています。属人SQLを減らす意味では、マーケ分析チームにも相性が良いです。

Meta などの指標定義変更は、どう報告すればよいですか?

新旧を単純比較せず、橋渡し期間を作るのが基本です。参照元 roundup でも、engage-through と click-through を一時的に併記する発想が示されています。重要なのは、数字の悪化か定義変更かを分けて説明することです。

GA4 と GSC の統合は Looker Studio のブレンドでも十分ですか?

簡易用途なら十分なこともありますが、Google Search Central は BigQuery を使った bulk exports 同士の結合をもっとも効果的な方法として案内しています。継続運用や高度分析を考えるなら、BigQuery 寄りの設計が有利になりやすいです。

AI-assisted analysis を導入するとき、最初に何を決めるべきですか?

最初に決めるべきなのはツールではなく、よく聞かれる質問です。毎週の会議で繰り返し出る問いを verified queries に落とし、必要な metadata と instructions を整えると、AI を補助役として使いやすくなります。

参考サイト

本文で使った重要論点の確認先を、参照元と公式ドキュメント中心にまとめています。

- Two Octobers「Analytics Roundup – April 2026」

- Google Search Central Blog「Introducing the branded queries filter in Search Console」

- Google Crawling Infrastructure「Google User-Triggered Fetchers」

- Google Search Central「Using Search Console and Google Analytics Data for SEO」

- Google Cloud Documentation「Conversational analytics in BigQuery」

- Google Cloud Documentation「Dataform overview」

「IMデジタルマーケティングニュース」編集者として、最新のトレンドやテクニックを分かりやすく解説しています。業界の変化に対応し、読者の成功をサポートする記事をお届けしています。

-2025-09-05T151236.591-320x180.png)

-7-320x180.png)

-34-120x68.png)