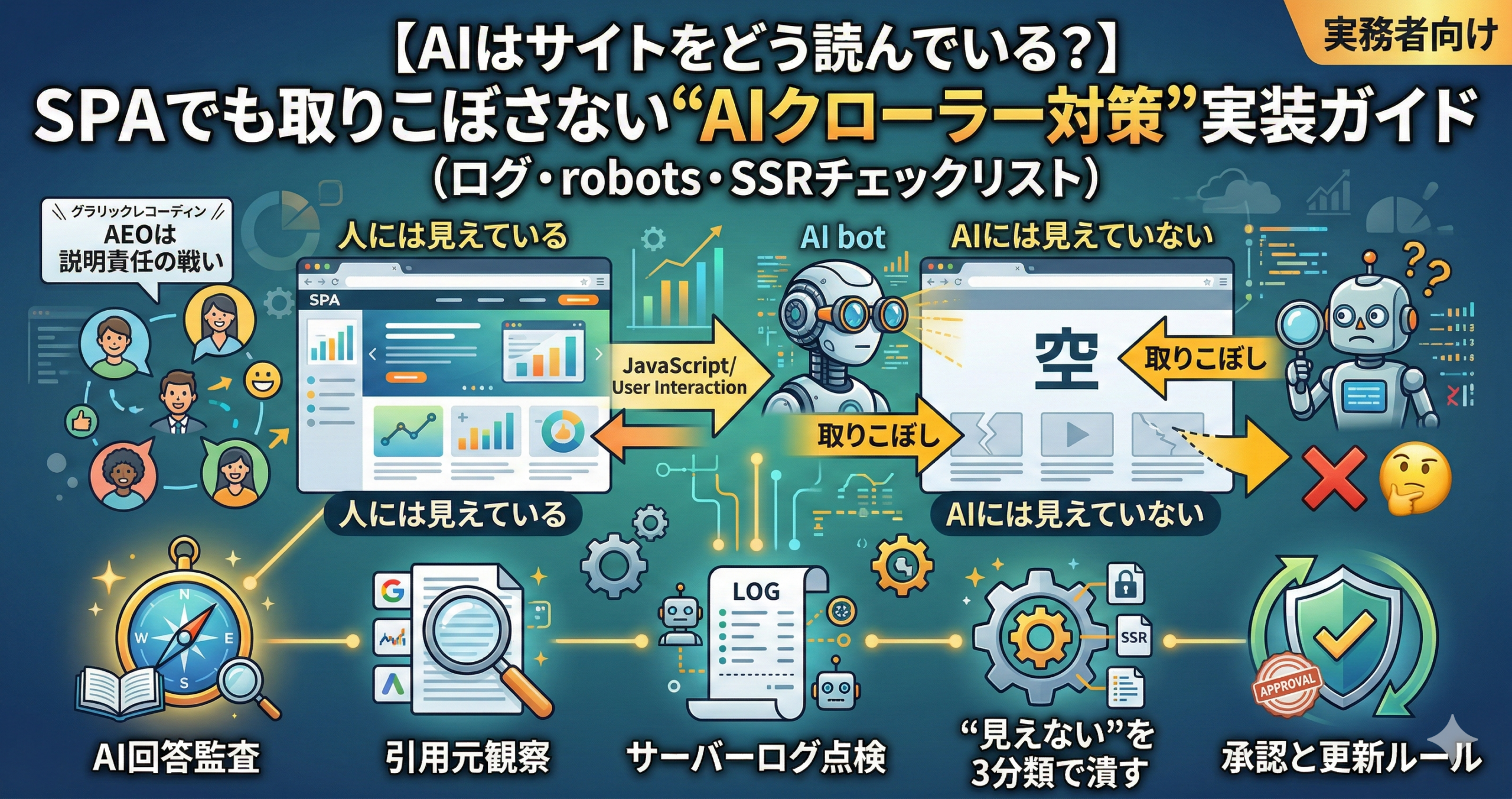

【AIはサイトをどう読んでいる?】SPAでも取りこぼさない“AIクローラー対策”実装ガイド(ログ・robots・SSRチェックリスト)

AIが検索や要約で答えを作るとき、あなたのサイトは“人が読む前”に評価されます。

そして評価の主体は、ユーザーではなくAIのクローラー/取得エージェント(ボット)です。

ここで問題になるのが、「人には見えているのに、AIには見えていない」というギャップです。

特にSPA(Single Page Application)やJavaScript依存のUI、遅延読み込み、動的コンテンツは、AIが必要なテキストや文脈を取りこぼしやすくなります。

本記事は、参照元の論点(AIがどうサイトを訪問し、何が障壁になるか)を踏まえつつ、直訳ではなく日本の実務に落とせる形で、監査→修正→運用の手順をまとめた実装ガイドです。

要点サマリー(最短でやること)

まず“AIが言っている内容”を確認する。

重要な質問(定義・比較・おすすめ・手順)で、自社がどう説明されているかを手動で棚卸しします。

競合と比較して“引用元”を観察する。

自社サイトが参照されていない場合、どのページが代わりに使われているかを確認します。

サーバーログでAIボットの来訪を確認する。

ボットが来ていない/来ているが主要ページを取れていない、のどちらかを切り分けます。

“見えない原因”を3分類で潰す。

アクセス可否(robots・WAF)、配信方式(SSR/プリレンダ)、内容品質(要約しやすさ)に分けて改善します。

運用ルール(承認と更新)を先に作る。

技術修正だけで終わらず、改修後もズレを検知して戻せる体制にすると成果が安定します。

イントロダクション

AEOはSEOの延長だが、評価される“入口”が違う

従来のSEOは「検索結果でどう順位が付くか」を中心に設計してきました。

一方、AEO(Answer Engine Optimization:回答エンジン最適化)は、「AIがあなたのブランドをどう説明するか」が中心になります。

ここで厄介なのは、AIがあなたのページへリンクを貼るだけでなく、文章を読み取り、要約し、比較し、結論を出すことです。

参照元が示す比喩として、AI検索は“伝言ゲーム”のようにズレが増幅しやすい、という考え方があります。

サイト側に情報の欠落や読み取りづらさがあると、AIは推測で穴埋めし、意図しない表現で語られる可能性が高まります。

さらに、推測が増えるほど競合が入り込む余地が増え、比較・推薦の文脈で不利になりやすいです。

🖍️ グラレコ風メモ:AEOで最初に問うべき4つ

- 可視性:AIの回答内で名前が出るか

- 正確性:説明が正しいか(誤解・混同がないか)

- 参照:自社サイトが引用・参照されているか

- 競合差:同じ質問で競合のほうが“おすすめ”されていないか

- AEOは「順位」より「AIがどう語るか」が主戦場になりやすい

- 人に見えるUIでも、AIボットには“空”に見えることがある

- 最初にやるべきは、改善ではなく“現状の可視化”

概要

AIは同じ“ボット”でも役割が違う。まず分類して設計する

参照元の重要な示唆は、AIの機械訪問が増えた結果、サイト側の設計が「人間向け」だけでは足りなくなっている点です。

ここで混乱しやすいのが、AIのボットが一種類ではないことです。

実務上は、少なくとも次のように考えると切り分けが楽になります。

| ボットの役割 | 何をしに来るか | 現場で起きがちな問題 | 優先する対策 |

|---|---|---|---|

| インデックス系 | ページを収集・解析し、検索の土台を作る | JavaScript依存で本文が取れず、評価が安定しない | レンダリング前提の設計を見直し、主要テキストをHTMLで届ける |

| 取得系(リアルタイム取得) | 質問に応じてページを取りに来て要約する | 遅延読み込みや認証・遮断で本文が空になりやすい | 重要ページの取得成功(200/本文)を担保し、軽量に返す |

| 学習系(収集) | モデル改善のための収集を行う場合がある | 許可・遮断の判断が社内で曖昧、ルールがない | ポリシー(許可/禁止/範囲)と例外運用を明文化する |

さらに、技術面では「アクセスできるか」「ちゃんと届くか」「内容が要約しやすいか」の三点に分解すると、改善が進みやすいです。

🧩 AIがサイトを読めない原因の3分類

- アクセシビリティ:robots.txt / WAF / CDN / 認証 / 403・429などで入れない

- コンテンツ配信:SPAの骨組みだけ返り、本文がJavaScript実行後にしか出ない

- コンテンツ品質:要点が散らばり、定義・条件・注意点が欠けていて推測が増える

- 対策は「ボットの種類」と「3分類」を掛け合わせると迷わない

- JavaScriptは悪ではないが、“本文が空”になる構成は危険

- アクセス制御は意図せず遮断しているケースが多い(まずログ)

利点

技術対策は“守り”に見えて、結果的に“攻め”の再現性を上げる

AIクローラー対策は、テクニカルSEOの延長に見えるかもしれません。

しかし実務の利点は、単に露出を増やすことだけではありません。

むしろ、説明のブレを減らし、比較・推薦の場面で不利になりにくい状態を作ることにあります。

日本の運用現場では、稟議や表現チェック、代理店/インハウスの分業が前提になることが多いです。

この環境では「個人の腕」より「テンプレ化された運用」が成果を安定させます。

AIが読める形に整えることは、検索だけでなく、営業資料・CS回答・広告訴求の一貫性にも波及しやすいです。

🎯 実務で効く利点

- AIの要約で誤解されにくくなり、問い合わせの前提が揃いやすい

- 比較・推薦の場面で、強みと条件が“短く正確に”伝わりやすい

- SPA/動的UIでも、本文が取得できるようになると取りこぼしが減りやすい

- 承認・更新のルールができ、改修が止まるリスクを下げやすい

- 代理店/開発/広報/法務の会話が「順位」から「説明の設計」へ寄る

🧩 対策を優先すべき判断基準

- 比較・おすすめ・手順・注意点など、要約されやすい質問が事業に直結している

- UIは豪華だが、本文が後から表示される(遅延読み込みが多い)

- CDN/WAFでボット対策を強めており、ログの把握ができていない

- 製品改定や料金改定が多く、古い説明が残ると機会損失が大きい

- 狙いは“AIに勝つ”ではなく“推測を減らす”こと

- 技術対策は、説明責任と運用速度を上げるための基礎工事

- 改修後に回る仕組み(監査と更新)がないと効果が薄れる

応用方法

監査→原因特定→修正の順で回す。まず“AIの目”を作る

応用方法は、やみくもに改修するのではなく、観測→比較→ログ→修正の順で進めるのが現実的です。

参照元の流れに沿いつつ、国内実務で回しやすい形に再構成します。

手動監査で“AIが言っている内容”を掴む

まずは主要なAIプラットフォームや検索の要約枠で、ユーザーが聞きそうな質問を投げます。

目的は、正解を探すことではなく、ギャップの種類を把握することです。

- 最初は“量”ではなく、事業に直結する質問だけで十分

- 誤りは「混同」「条件欠落」「古い情報」のどれかに分類すると直しやすい

- この記録が稟議・開発依頼の根拠になる

競合比較で“参照元の戦い方”を掴む

次に、AIに「A社とB社を比較して」「おすすめを選んで」と聞きます。

ここで見るべきは、好き嫌いの評価ではなく、どの情報が判断材料になっているかです。

| 観察ポイント | よくある状態 | 原因の候補 | 修正の方向 |

|---|---|---|---|

| 競合が優位に語られる | 比較軸が競合に有利 | 自社が“選び方の軸”を提示していない | 選び方ガイド・比較軸の定義を自社で公開する |

| 自社が出ない | 引用元に自社サイトがない | 取得失敗/本文が空/重要情報が散在 | 重要ページをAIが読めるHTMLで返し、要点を集約する |

| 説明が微妙に違う | 条件や注意点が欠落 | 断片情報から推測されている | 条件付き説明、対象外ケース、注意点と対策を明文化する |

| 古い情報が混ざる | 旧仕様・旧プランが残る | 更新履歴や差分が見えない | 変更点ページ、更新日、差分説明を整備し運用する |

- 比較で勝つには、相手を下げるより“選び方”を提示する

- 引用元が自社でないなら、技術か情報設計のどちらかに課題がある

- 古さの混入は、更新運用(責任者と手順)がないと止まりにくい

ログで“入れているか/取れているか”を確定する

ここが実装の分岐点です。

AIボットの来訪がないなら、アクセス制御の問題が濃厚です。

来訪はあるのに主要ページが取れていないなら、配信方式や本文の出し方が課題になります。

🛡️ 実務の注意点:遮断は“意図せず”起きる

- CDN/WAFの既定設定で、AIクローラーが止まっていることがある

- レート制限(429)やチャレンジ画面で本文が返っていないことがある

- robots.txtだけでなく、アプリ側の認証・リダイレクトで落ちることがある

- ログは、開発依頼と稟議の“証跡”になる

- 来訪があっても、本文が空ならAIには存在しないのと同じ

- 結論は「アクセス可否」「配信方式」「内容品質」の3分類に戻す

- 応用の最短ルートは「手動監査→競合比較→ログ確認」

- 修正は、まず重要ページの“本文がHTMLにある状態”を作る

- 改善は一度で終わらず、定期監査でズレを検知して戻す

導入方法

SPA/JavaScriptサイトでも回る、技術チェックリストと運用フロー

ここからは「実際にどう直すか」を、実務で回る単位に落とします。

ポイントは、いきなり全ページを直さないことです。

まずは売上・問い合わせに直結する“重要ページ群”だけで、AIが読める状態を作ります。

運用フロー(おすすめ)

🧭 対象を決める

比較・導入・注意点に当たる重要ページを選ぶ(少数でOK)。

🔎 取得を確認

ボット取得で本文がHTMLにあるか、200で返るかを確認。

⚙️ 配信を直す

SSR/SSG/プリレンダなどで“本文が先に届く”状態へ寄せる。

🧩 内容を整える

短い結論、条件、注意点、FAQを追加し推測を減らす。

🔁 再監査

同じ質問で再テストし、ズレが残るなら原因分類に戻す。

| チェック領域 | チェック項目 | OKの目安 | NG例 | 修正の方向 |

|---|---|---|---|---|

| アクセシビリティ | robots.txt / WAF / レート制限 | 主要ボットが重要URLを200で取得できる | 403/429が多い、チャレンジ画面で本文が返らない | ポリシー整理・例外ルール・許可範囲の明文化 |

| 配信方式 | SPAの初期HTMLに本文があるか | JavaScript実行前でも要点テキストが存在 | 骨組みだけ、本文が後から注入される | SSR/SSG/プリレンダで本文を先に返す |

| リンク構造 | 重要ページへ到達できるか | 通常リンク(aタグ)で辿れる | クリックイベント依存、無限スクロールで深部が取れない | 静的導線・ページ分割・一覧/目次の整備 |

| コンテンツ品質 | 定義・条件・注意点・FAQ | 短い結論+条件付き説明がある | 抽象的で推測が増える、例外が書かれていない | 答えブロック化、比較軸の定義、更新履歴 |

| 整合性 | ボット向けと人向けの差 | 同じ要点が同じ順序で読める | 内容が大きく違う | 同一内容を保った上で配信方式を改善する |

🧯 よくある失敗

- AI対策として記事を増やすが、本文が取れず成果が出ない

- アクセス制御の既定設定で、重要ボットを意図せず遮断している

- 重要ページが無限スクロールや遅延読み込み中心で、取得が安定しない

- 改修しても再監査しないため、いつの間にか戻ってしまう

- 運用ルールがなく、古い情報が残って誤解が固定化する

- 導入の鍵は「重要URLだけ先に直す」こと

- 技術とコンテンツはセット(本文が届く+要点がまとまっている)

- 運用(再監査・更新)まで含めて初めて安定する

未来展望

サイトは“読む対象”から“取得される素材”へ。AI向けの体験設計が必要になる

今後、AIの取得行動は増えやすく、ボットは「検索のための収集」だけでなく「質問に応じた取得」へ寄りやすいです。

その結果、サイトは“読ませるページ”だけでなく、“取得される素材”としての品質が問われます。

これはテクニックというより、プロダクトの一部としての設計課題です。

実務者としての備えは、特定ツールに依存することではありません。

重要なのは、AIが見ている状態を観測し、障壁を分類し、修正を回す運用を持つことです。

SPAでも、配信方式と情報設計を整えることで、取得と要約のズレは小さくできます。

🔭 これから効いてくる運用テーマ

- 重要ページは“本文が先に届く”配信方式を標準にする

- 定義・条件・注意点・FAQを答えブロックとして整備する

- アクセス制御はポリシー化し、遮断の意図と例外を明文化する

- ログと再監査を運用に組み込み、ズレを早期に検知する

- 稟議テンプレで、開発・広報・法務を巻き込みやすくする

🧩 成熟度チェック(AIクローラー運用)

- 初期:AIの説明に違和感はあるが、ログ・取得状況が把握できていない

- 中期:重要URLで本文がHTMLに乗り、再監査で改善が回り始めた

- 定着:アクセス制御・更新・承認のテンプレが揃い、戻りが起きにくい

- 拡張:比較・おすすめ・手順の質問まで含め、答えブロックが体系化されている

- 未来対応は“特別な施策”ではなく“標準化”で進む

- 観測と運用があるチームほど、変化に強くなる

- SPAの課題は、配信方式と情報設計で縮められる

まとめ

AIに推測させない。読めるHTMLと答えの素材で、伝言ゲームを止める

AIがサイトを訪問し、内容を解釈し、ユーザーへ要約して伝える時代では、“AIが見える状態”を作ることが成果の前提になります。

特にSPA/JavaScript依存のサイトでは、人間の体験が優れていても、AIには本文が空に見えることがあります。

そのギャップを埋めるには、アクセス可否、配信方式、内容品質の3分類で課題を潰し、監査→修正→再監査を運用として回すことが有効です。

🧷 明日からの最短アクション

- 重要な質問(定義・比較・手順)でAIが自社をどう説明しているかを記録する

- 競合比較で引用元を観察し、自社サイトが参照されているか確認する

- ログでAIボットの来訪と取得成功(200/本文)を確定する

- 重要ページだけ、本文がHTMLに乗る配信方式へ寄せる(SSR/プリレンダ等)

- 定義・条件・注意点・FAQを整備し、推測される余地を減らす

- 最初のゴールは“露出”より“正確に語られる”こと

- 技術とコンテンツはセットで効く

- 再監査と更新運用がないと、改善は長持ちしにくい

FAQ

詰まりやすいポイントを、判断基準に変える

AIクローラー対策は、難しい技術をすべて理解する必要はありません。

重要なのは「どこで失敗しているか」を分類して、最短で直すことです。

AIクローラーは本当に自社サイトに来ていますか?

来訪の有無はサーバーログで確定できます。

User-Agentだけでなく、対象URLとステータスコード(200/3xx/4xx/5xx)、レスポンスサイズも合わせて見ると、取得できているかまで切り分けられます。

SPAをやめないとAIに読まれませんか?

直ちにやめる必要はありません。

重要ページだけでも、本文がHTMLに乗る配信方式(SSR/SSG/プリレンダ等)へ寄せると改善が進むことがあります。

どのページを優先して直すべきですか?

比較・おすすめ・導入手順・注意点のページから優先すると、影響が出やすいです。

まずは少数の重要URLで検証し、勝ち筋が見えたら横展開するのが安全です。

技術修正だけで十分ですか?

十分にならないことが多いです。

AIは“要点の素材”がないと推測が増えます。短い結論、条件、注意点、FAQ、更新履歴を整備すると、説明のブレが減りやすいです。

稟議や承認が重く、改修が止まりがちです。

禁則・例外運用・更新手順をテンプレ化すると止まりにくくなります。

「何をするか」より「何をしないか」「どこまでが現場裁量か」を先に決める設計が有効です。

再監査はどれくらいの頻度がよいですか?

変化が速い領域(新製品・比較・話題性の高い領域)ほど短い周期が向きます。

まずは月次で、重要クエリと重要URLだけを再確認する運用から始めるのがおすすめです。

- まずログで来訪と取得成功を確定する

- 重要URLだけ、本文がHTMLに乗る形へ寄せる

- 答えの素材(条件・注意点・FAQ)と更新運用が安定の鍵

参考サイト

参照元と、技術設計の一次情報(最大五件)

- Search Engine Journal「What AI Sees When It Visits Your Website (And How To Fix It)」

- Google Search Central「Understand JavaScript SEO Basics」

- Google Search Central「Googlebot」

- OpenAI「Overview of OpenAI Crawlers」

- Cloudflare「Content Independence Day: no AI crawl without compensation」

© 各サイトの権利は各権利者に帰属します。本記事は参照元の論点を踏まえつつ、日本の実務(稟議、KPI設計、代理店/インハウス、ブランド統制、技術改修の進め方)に合わせて独自に再構成しています。

「IMデジタルマーケティングニュース」編集者として、最新のトレンドやテクニックを分かりやすく解説しています。業界の変化に対応し、読者の成功をサポートする記事をお届けしています。

-2025-09-05T151236.591-320x180.png)

-7-320x180.png)

-2025-09-19T155635.740-120x68.png)

-51-120x68.png)